在数学优化与工程决策领域,极大与极小的方法研究是核心议题之一,其目标是在给定约束条件下寻找目标函数的最优值,这类方法不仅广泛应用于机器学习、经济学、物理学等理论学科,也在工程设计、资源调度等实际问题中发挥着关键作用,从理论到实践,极大与极小的方法经历了从古典解析解到现代数值算法的演变,形成了多样化的技术体系。

从理论层面看,古典微积分中的极值理论是极大与极小方法的基础,对于一元或多元可微函数,通过求导并令导数为零,可找到函数的驻点,再结合二阶导数或Hessian矩阵判断极值的性质,对于二元函数( f(x,y) ),其极值点需满足( \frac{\partial f}{\partial x} = 0 )和( \frac{\partial f}{\partial y} = 0 ),且Hessian矩阵的行列式( D = f{xx}f{yy} - (f{xy})^2 )满足( D > 0 )时为极值点(( f{xx} > 0 )为极小值,( f_{xx} < 0 )为极大值),这种方法仅适用于无约束且函数光滑的情况,对于非光滑函数或带约束的问题,则需要更复杂的理论工具。

约束优化问题中,拉格朗日乘数法和KKT条件是解决等式与不等式约束的核心方法,以拉格朗日乘数法为例,对于目标函数( f(x) )在约束( g(x) = 0 )下的极值,可构造拉格朗日函数( \mathcal{L}(x, \lambda) = f(x) - \lambda g(x) ),通过求解( \nabla \mathcal{L} = 0 )得到极值点,而KKT条件则进一步推广到不等式约束,引入互补松弛条件,成为非线性规划的理论基石,这些方法将约束问题转化为无约束问题,但求解过程往往需要迭代算法,如梯度下降法、牛顿法等。

随着问题复杂度的增加,尤其是高维、非凸或离散优化问题,传统解析方法难以适用,数值优化算法成为研究重点,梯度下降法通过沿目标函数的负梯度方向迭代更新变量,逐步逼近极小值,但其收敛速度依赖学习率选择,且易陷入局部极小,为此,改进算法如动量法、AdaGrad、Adam等被提出,通过自适应调整学习率或引入历史梯度信息提升性能,对于极大值问题,可通过目标函数取负转化为极小问题,或使用上升法沿梯度方向迭代。

在非光滑优化领域,次梯度法和次微分理论被广泛应用,对于( f(x) = |x| )在( x=0 )处不可导,其次梯度( \partial f(0) = [-1, 1] ),通过次梯度投影算法可找到最小值,凸优化问题因其全局最优性保证,成为研究热点,内点法、投影次梯度法等高效算法被不断开发。

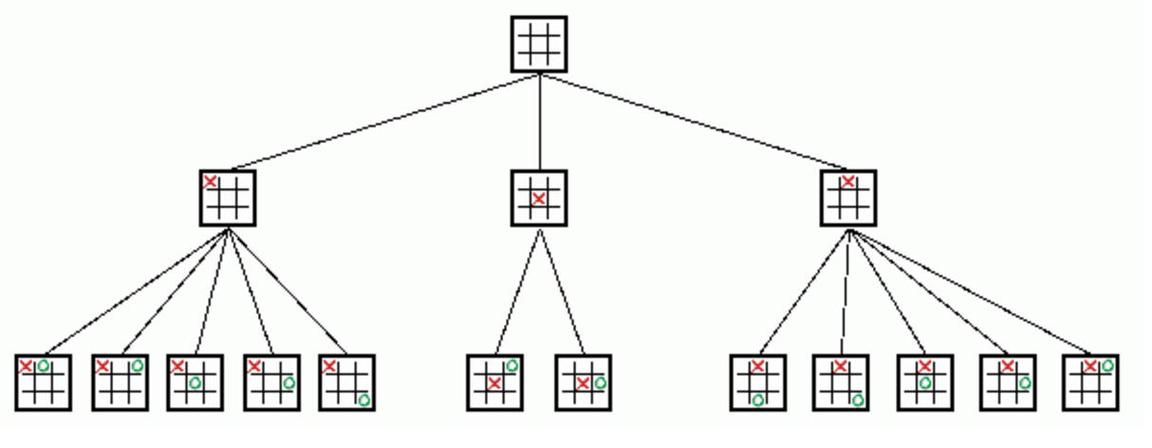

针对组合优化问题(如旅行商问题、背包问题),启发式与元启发式算法成为重要工具,遗传算法、模拟退火、粒子群优化等通过模拟自然进化或物理过程,在解空间中搜索全局最优或近似最优解,模拟退火算法通过接受劣解的概率机制跳出局部极小,而粒子群优化则通过粒子间的信息共享与位置更新实现高效搜索,这些方法虽不能保证全局最优,但在大规模问题中表现出良好的实用性。

下表对比了常见极大与极小方法的特点:

| 方法类型 | 代表算法 | 适用场景 | 优势 | 局限性 |

|---|---|---|---|---|

| 古典解析法 | 拉格朗日乘数法 | 等式约束、光滑函数 | 理论严谨,可得到精确解 | 仅适用于简单问题,维度受限 |

| 数值优化法 | 梯度下降法、牛顿法 | 无约束或简单约束优化 | 收敛速度快,实现简单 | 依赖初始值,易陷入局部极小 |

| 凸优化法 | 内点法、次梯度法 | 凸优化问题 | 全局最优性保证 | 要求问题凸性,计算复杂度高 |

| 启发式算法 | 遗传算法、模拟退火 | 组合优化、非凸问题 | 全局搜索能力强,适用大规模问题 | 解的质量不稳定,参数敏感 |

实际应用中,极大与极小方法的选择需结合问题特性,在机器学习中,损失函数的极小化通常采用梯度下降或其改进算法;而在工程设计中,结构优化可能需要结合KKT条件与有限元分析,随机优化方法(如随机梯度下降)通过引入噪声提升算法的鲁棒性,适用于大数据场景。

未来研究趋势包括:开发高效的非凸优化算法以解决深度学习中的训练难题;结合强化学习实现动态优化问题的自适应求解;以及探索量子计算在极值问题中的应用潜力,这些进展将进一步拓展极大与极小方法的理论边界与应用范围。

相关问答FAQs:

-

问:梯度下降法为什么容易陷入局部极小?

答:梯度下降法的目标是沿当前梯度方向迭代更新参数,若目标函数存在多个局部极小值点,算法可能在初始点附近收敛到局部极小而非全局极小,对于非凸函数,鞍点也可能导致收敛停滞,改进方法包括使用随机梯度下降(通过噪声跳出局部极小)、动量法(加速穿越平坦区域)或结合全局优化算法(如模拟退火)。 -

问:如何判断一个优化问题是凸问题?

答:凸问题的判断需满足两个条件:一是可行域为凸集(即任意两点的连线仍在可行域内);二是目标函数为凸函数(对于多元函数,需满足Hessian矩阵半正定),线性规划问题既是凸问题(目标函数线性,可行域为多面体),而二次规划问题若其Hessian矩阵正定则为严格凸问题,可通过验证函数的二阶条件或凸函数的定义(如( f(\lambda x + (1-\lambda)y) \leq \lambda f(x) + (1-\lambda)f(y) ))进行判断。